На днях мы рассказывали вам о том, что в сети весьма бурно обсуждается синтезированный голос Дага Кокла в модификации A Night to Remember для The Witcher 3. С нами вышел на связь генеральный директор Mind Simulation, создавшей CyberVoice, чтобы расставить все точки над i в данном вопросе.

Тема использования синтезированного нейросетями видео, которые мы с вами знаем под названием DeepFake, немного поулеглась и сейчас уже мало кого удивишь различными фейками, как весьма посредственного качества, так и весьма хорошего. Но набирает обороты новая волна – синтез голоса. Согласитесь – это просто невероятный инструмент для создания различного контента. Тут вам и озвучка книг, роликов, модификаций к играм и многого, многого другого. Объем контента, который требует озвучки, растёт невероятными темпами и тут нам на помощь могли бы прийти системы, которые автоматизировали бы этот процесс. Но как вы понимаете, есть нюансы.

Отечественная лаборатория Mind Simulation уже давно занимается исследованиями в области общего искусственного интеллекта. Лаборатория является членом Конфедерации лабораторий по исследованиям искусственного интеллекта в Европе (CLAIRE) и соавтором основной в настоящее время книги о сильном искусственном интеллекте на русском языке под названием «Сильный искусственный интеллект. На подступах к сверхразуму». Им удалось создать уникальный синтезатор голоса, который многие зарубежные издания, вроде Kotaku и Vice назвали лучшим среди доступных на текущий момент. Однако, по всей видимости, похвалы оканчиваются в том самом месте, где голос, сгенерированный искусственно, начинает быть неотличим от настоящего. Наступает этакий эффект зловещей долины.

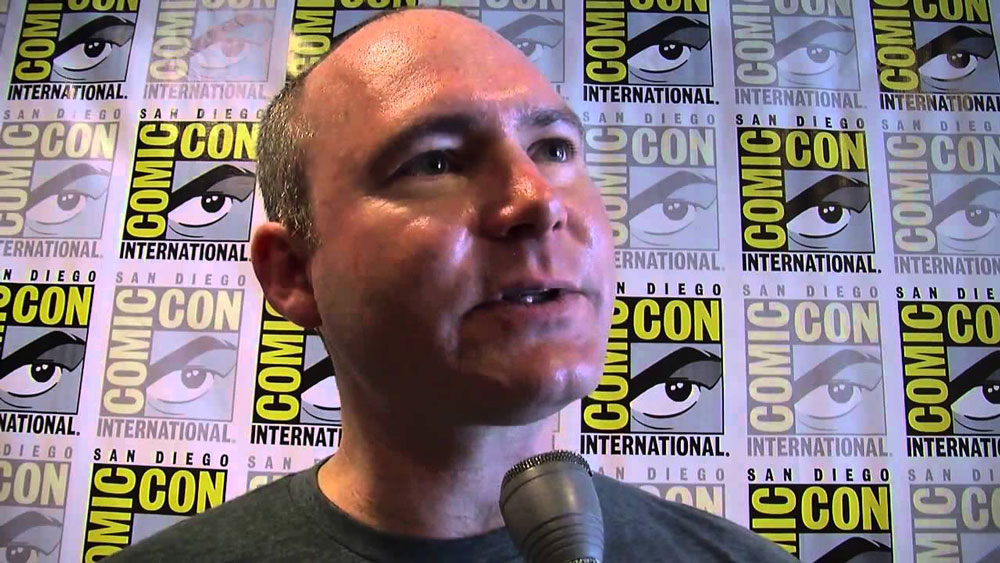

[embedyt] https://www.youtube.com/watch?v=G9PaIYR6uwg[/embedyt]Совсем недавно издание inputmag.com пыталось разобраться в этичности вопроса вокруг модификации A Night to Remember, о которой мы говорили ранее. Они обратились за комментариями к генеральному директору Mind Simulation, Леониду Дерикьянцу. Однако, по какой-то причине выставили всю ситуацию в не очень радужном свете. Напомним, что голос очень похожий на голос актера Дага Кокла, который озвучивал английский вариант Геральта, не доступен для коммерческого использования и присутствует лишь в форме сэмплов на главной странице проекта. Это сделано потому, что компания не дает возможности своим клиентам использовать голоса актеров, которые не присоединились к их платформе. Mind Simulation готова исправно платить отчисления авторам, которые согласятся участвовать в проекте. Как вы понимаете, Даг Кокл не является таким участником, а значит и использовать его голос невозможно.

Издание inputmag.com по какой-то причине сделало упор на неэтичность подобных синтезов. Они описали позицию разработчиков CyberVoice, при этом указав, что связались с автором модификации, который сообщил им, что разработчики сами передали ему сэмплы с голосом Кокла. И вот тут нас ожидает самое интересное – контекст. При прочтении возникает ощущение, что Леонид юлит, но оказалось всё гораздо проще. Автор мода, тоже наш соотечественник, обратился к разработчикам с просьбой посмотреть текст его реплик для модификации и, если у них будет какая-либо возможность, помочь в синтезе данных реплик. Изначально автор мода хотел использовать сторонний синтезатор, но результат синтеза его не впечатлил. Кстати, хотелось бы отметить, что в сети можно найти большое количество различных синтезаторов, которые в полном смысле слова являются генераторами нелегального и контента весьма посредственного качества. Разработчики из Mind Simulation просмотрели текст, удостоверились что весь проект модификации носит некоммерческий характер и сами синтезировали у себя в лаборатории сэмплы для чуть более, чем 30 реплик, передав их автору. Тем самым они просто помогли автору мода. В течение почти двух недель пользователи игравшие в модификацию думали, что реплики озвучил сам Кокл, но потом синтез распознали.

Фактически, Mind Simulation не сделали ничего плохого, так как они не воспроизвели голос именно Дага Кокла. Да, финальный результат очень похож, но, как я писал в оригинальной статье, на текущий момент нет никакой регуляторной базы для того, чтобы как-либо обвинить в плагиате или умышленном копировании речи. В разговоре Леонид ещё раз хотел уточнить, что они ни в коем случае не ратуют за то, чтобы создавались синтезированные голоса, похожие на голоса знаменитых людей и их использовали как кому вздумается.

“Мы хотим создать прецедент и обратить на это внимание. Голос – это важный актив, нас ждёт эра дипфейков, готовится(регулировать – прим. ред) надо сейчас” – прокомментировал генеральный директор Mind Simulation, Леонид Дерикьянц.

Если же вы думаете, что подобный синтез речи не привлекает актёров озвучания, то вы сильно ошибаетесь. По словам Леонида, на текущий момент в проекте участвует много профессиональных дикторов, блогеров и актёров дубляжа. Среди участников есть Андрей Зайцев – профессиональный российский актёр дубляжа. Для российских зрителей и поклонников Звёздных войн он известен тем, что в приквелах дублировал известного персонажа – Рыцаря-Джедая Энакина Скайуокера (Хейден Кристенсен) . Позже он озвучил этого персонажа в мультсериале Звёздные войны: Войны клонов. Он также озвучил супергероя Звёздного Лорда (Крис Пратт) в Стражах Галактики и Уилла Тёрнера (Орландо Блум) в Пиратах Карибского моря, видеоблогер Гейб Фолловер, который даже выпустил полностью синтезированное видео, и многие другие.

[embedyt] https://www.youtube.com/watch?v=gZpRL0oWnVw[/embedyt]Так или иначе – использование синтеза голоса, ещё один шаг в не самое светлое будущее дипфейков. И очень радует, что часть разработчиков хочет сделать его гораздо светлее, честнее уже сейчас, пытаясь начать привлекать общественное внимание к данной области. Мы будем активно следить за успехами этой технологии, а вам, дорогие друзья, советуем всегда подходить к оценке событий с разных сторон, ведь только тогда вы увидите истинную картину.

Telegram

Telegram Google News

Google News Дзен

Дзен Feedly

Feedly

Комментарии